Appleは言っている。「新しいMacBook ProはローカルLLMにいいぞ」と

03/04 06:16

GIZMODO

ここまで推してくるとは。

2026年3月3日、Appleが新しいMacBook Air/Proを発表しました。MacBook Airは新しい頭脳としてM5チップを搭載し、MacBook ProはM5 Pro/Maxチップを選択できるようになりました。

高すぎるとかいや妥当だよとか言えることはいろいろありますが、この記事では主にMacBook Proの「AI性能」にフォーカスします。といっても、Apple Intelligenceの話ではありません。

先取りして結論を述べてしまうと、新型MacBook ProがローカルLLMを動作させるのにかなり向いた性能になっています。では、どんなところがローカルLLMにハマっているのか? またどのように活かせるのでしょうか?

「ユニファイドメモリ×広いメモリ帯域幅」が強い

AppleはMacBook Pro(M5 Pro/Max)のプレスリリースで以下のように述べているのですが、今回の文脈で重要なのは太字にした部分。「一般向けのローカルLLMマシンとしては本当に強いんだぜ」ってアピールになっています。

Appleが設計した新しいFusionアーキテクチャを使用して作られたM5 ProとM5 Maxは、先進的なCPU、Neural Acceleratorsを搭載した次世代のGPU、大幅に増加するAI演算のための、より高いユニファイドメモリ帯域幅を備えています

「ユニファイドメモリ」「メモリ帯域幅」ってなんだ?

この「ユニファイドメモリ帯域幅」、実は2つのことを言っています。ざくっと分解整理しちゃいましょう。

・ユニファイドメモリ:CPUとGPUがメモリを共有する仕様のこと。「GPU側のメモリが足りなくてAIが動かない」となりにくい

・メモリ帯域幅:この値が大きいほど、ローカルLLMのロードや回答生成の速度を体感しやすい

ローカルLLMは、コンシューマ向けのPCで行う中ではもっともヘビーな部類に入る処理です。小さいモデルでも数GB、大きいものだと数十GBものファイルサイズがあり、これをメモリにロード&GPUをフル回転させて推論(=AIが答えを生成する処理)をさせます。

メモリ量が足りないと動かしたいモデルを動かせず、その上で読み込み・読み出しのスピードも利用感に影響してきます。性能不足だと、モデルをロードしたり、回答が出てくるまでに時間がかかります。使ってられないほど重い、とかもぜんぜんありえます。

好みのローカルLLMを“実際に動かしやすい”仕様ってこと

新型MacBookが採用するApple独自チップ「M5」シリーズは全体的にメモリ帯域幅が広く、標準的なM5でさえ153GB/sあります。これは一般的なPC(例:DDR5-5600のデュアルチャネルで理論上おおよそ90GB/s)よりも高い値であり、快適に動かせるモデルも多くなっています。M5 Proモデルのメモリを36GBまで盛れば、gpt-oss-20bのような汎用性が高いモデルを相応の水準で動かせる可能性が高いです。

最上位版の「M5 Max」はメモリ帯域幅が614GB/sと非常に広くなっており、これはNVIDIAのGPU「RTX 4070 Ti Super」(672GB/s)に迫ります。大型ローカルLLMをロードできるだけのメモリを確保しやすいのも大きな魅力で、メモリを128GBまで盛れば、高性能なgpt-oss-120bも実用水準で動くのではないかと思われます。

専用GPUがパワフルだけどVRAMの限界があるという特性上、画像生成AIなどとの相性が良くなっているのに対し、ハイエンドMacはローカルLLMとの親和性が妙に高くなっています。本格的な利用環境としても有力候補です。

高価なのがやっぱりネック

価格は高いとしか思えないと思いますが、AIの要求スペックって本当にエグいので致し方ないところがあります。さまざまなパーツが高騰している現状だと、自作などで専用マシンを用意するよりは総合的には敷居が低いかもしれませんが…でもまぁ高いです。

なお、実際にどういったスペックでどのローカルLLMが快適に動くかは、発売後(3月11日以降)に徐々に明らかになっていくはず。実際に購入するのは、どの程度メモリを盛ればいいのかなどを見極めてからがいいでしょう。

ローカルLLMってどう使うもの?

Appleは新型MacBook Proのプレスリリース内で具体的な利用イメージを紹介しており、これらは「実際にどう使うか?」を考える際に参考になると思います。

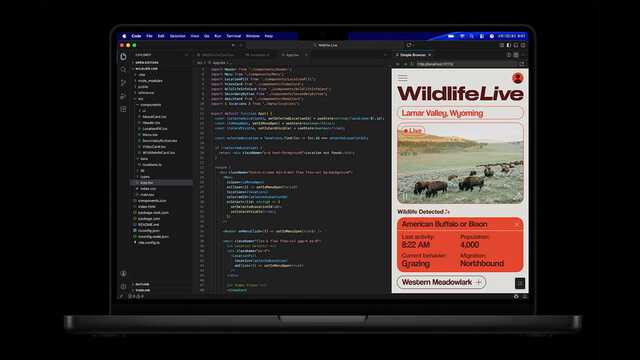

まず、「LM Studio」でローカルLLM「qwen3-coder-next」をロードし、「Xcode」(Appleの開発ツール)と接続、コーディングアシスタントとして利用している様子が紹介されています。

個人的にもおすすめの使い方です、やってて楽しいんですよね。公式の動画ではノリノリでバイブコーディングしてるシーンがありますが、コーディングアシスタントって没入感がすごい。自分もそんな感じになります。

Visual Studio CodeなどからもローカルLLMは利用できるので、Swift以外の言語での開発も可能です。自分はCursorからローカルLLMをコーディングアシスタントにしてPythonプログラミングしたりしてます。ざっくり「AIを用いたプログラミングがやりたい放題」という理解でOKです。

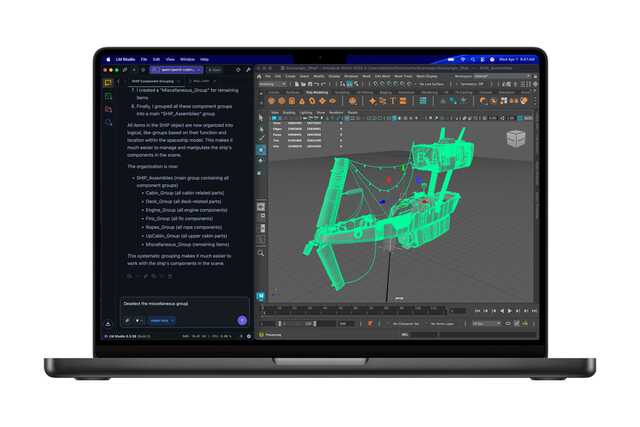

また、3DCG制作ソフトウェア「Autodesk Maya」とLM StudioをMCPで接続し、「グループの選択を解除して」とローカルLLM経由で操作している様子も紹介されています。

ローカルLLMを動かすアプリ(今回はLM Studio)を使ってAIを起動・常駐させ、別のアプリと連携させて使うというのが基本的なイメージです。利用しているツールが対応してさえいれば、ローカルLLMを活かして新しいスタイルを開拓していける感じですね。

LM Studio・Ollama・Open WebUIなど、さまざまなローカルAIツールが基本機能としてAIチャット機能を備えていますから、チャットAIとして使うことももちろん可能です。性能・機能ではChatGPTなどに劣りますが、使い放題で、会話内容が外に出にくいのが強みとなります。